Je hebt misschien wel of niet gehoord van prompt engineering. Het komt er in feite op neer dat je 'effectief communiceert met een AI om te krijgen wat je wilt'.

De meeste mensen weten niet hoe ze goede aanwijzingen moeten ontwerpen.

Maar het wordt steeds belangrijker...

Omdat rommel erin = rommel eruit.

Hier zijn de belangrijkste technieken die je nodig hebt voor het stimuleren 👇

Ik zal een taalmodel aanduiden als 'LM'.

Voorbeelden van taalmodellen zijn ChatGPT van @OpenAI en Claude van @AnthropicAI.

1. Persona/rol aanmoediging

Een rol toewijzen aan de AI.

Voorbeeld: "Je bent een expert in X. Je hebt mensen geholpen om Y te doen gedurende 20 jaar. Jouw taak is om het beste advies te geven over X.

Antwoord 'begrepen' als dat duidelijk is."

Een krachtige add-on is de volgende:

'Je moet altijd vragen stellen voordat je antwoord geeft, zodat je beter kunt begrijpen waar de vragensteller naar op zoek is.'

Ik zal zo meteen uitleggen waarom dat zo belangrijk is.

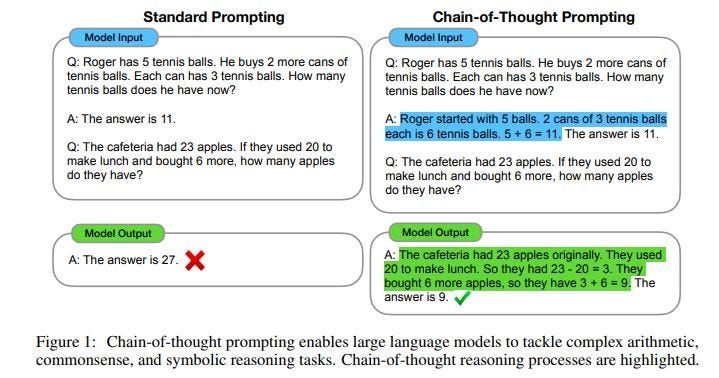

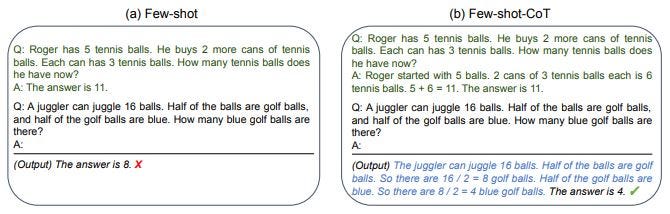

2. CoT

CoT staat voor 'Keten van Gedachte'

Het wordt gebruikt om de LM te instrueren om zijn redenering uit te leggen.

Voorbeeld:

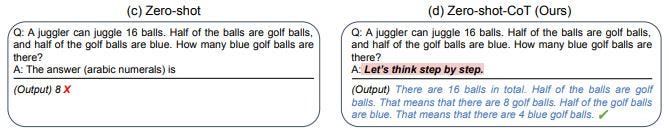

3. Zero-shot-CoT

Zero-shot verwijst naar een model dat voorspellingen maakt zonder extra training binnen de opdracht.

Ik zal zo meteen ingaan op few-shot.

Let op dat meestal CoT > Zero-shot-CoT

Voorbeeld:

4. Enkele opnames (en enkele opnames-CoT)

Weinig voorbeelden is wanneer de LM een paar voorbeelden krijgt in de prompt zodat het zich sneller kan aanpassen aan nieuwe voorbeelden.

Voorbeeld:

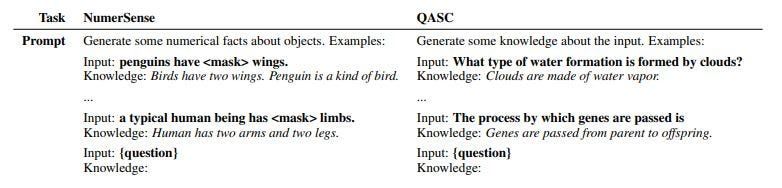

5. Kennisgeneratie

Genereren van vraaggerelateerde kennis door een LM te activeren.

Dit kan worden gebruikt voor een gegenereerde kennisprompt (zie verder).

Voorbeeld:

6. Gegenereerde kennis

Nu we kennis hebben, kunnen we die informatie invoeren in een nieuwe prompt en vragen stellen die verband houden met de kennis.

Een dergelijke vraag wordt een 'kennisverrijkte' vraag genoemd.

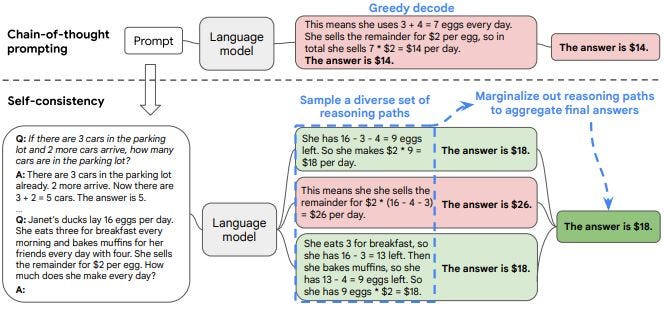

7. Zelfconsistentie

Deze techniek wordt gebruikt om meerdere redeneringspaden (gedachtegangen) te genereren.

Het meerderheidsantwoord wordt beschouwd als het definitieve antwoord.

Voorbeeld:

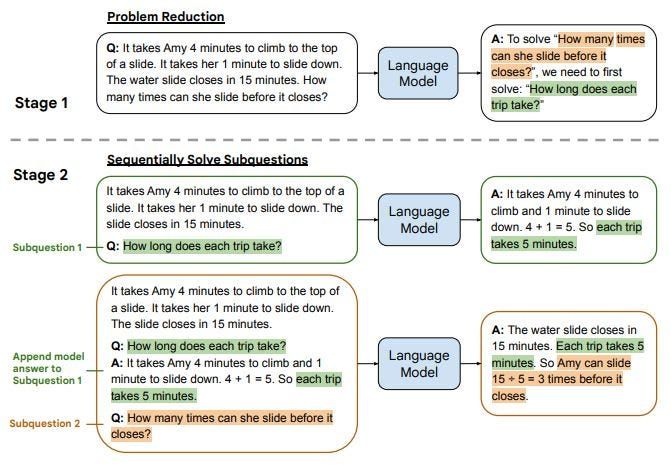

8. LtM

LtM staat voor 'Van Minst naar Meest'

Deze techniek is een vervolg op CoT. Daarnaast werkt het door een probleem op te delen in deelproblemen en deze vervolgens op te lossen.

Voorbeeld: